- Visualizza Nuovi Contenuti

- Nikonland

- Sezioni

- Test

- Guide agli acquisti

- Indice Articoli

- Blog

- Forum

-

Fotografie

- Novità dalle Gallerie Fotografiche di Nikonland

- Una foto soltanto : Consigli & Critiche

- Ultime Immagini Caricate

- Ultimi Commenti

- _____________________________

- Contest e occasioni speciali di Nikonland

- Natura

- Fiori

- Ritratto

- Nudo

- Street

- Motori (auto e moto)

- Paesaggi e Panorami

- Architetture

- Viaggi e reportage di viaggio

- Sport (no motori)

- Vendo e Compro

- Downloads

-

Altro

Benvenuti su Nikonland Questo sito è indipendente, è autofinanziato, non promuove e non raccoglie pubblicità. Non è collegato con Nikon, Nital o le loro sussidiarie

Nikonland non è una rivista periodica e non è quindi sottoposta alla normativa vigente

Ultimi Test

-

Panasonic Lumix DC- GH5: changing photography

Panasonic Lumix DC- GH5: changing photographyMax Aquila - gen 04 2018 17:26

-

Sony Vario Sonnar 2,8/24-70 ZA SSM II: lo Zeiss...

Sony Vario Sonnar 2,8/24-70 ZA SSM II: lo Zeiss...Max Aquila - ago 08 2017 10:39

-

Nikon 24-70mm F2.8E VR (test/prova)

Nikon 24-70mm F2.8E VR (test/prova)Lieve - ago 02 2017 16:25

-

Nikon D7500 o Nikon D500 : quale scegliere ? (g...

Nikon D7500 o Nikon D500 : quale scegliere ? (g...Lieve - ago 01 2017 12:38

-

Nikon D7500 : io non ho paura ! (test/prova)

Nikon D7500 : io non ho paura ! (test/prova)Lieve - ago 01 2017 13:59

Altri Contributi

-

[libro Nikonland centenario] Il Terzo Occhio

[libro Nikonland centenario] Il Terzo OcchioAlberto Coppola - ago 17 2017 15:43

-

[reportage] Non è più strano... il Tai Chi Chuan nei Parchi a Milano.

[reportage] Non è più strano... il Tai Chi Chuan nei Parchi a Milano.Silvio Renesto - ago 05 2017 13:16

-

100 anni di Nikon il mito intramontabile

100 anni di Nikon il mito intramontabileRoby C - ago 04 2017 14:49

-

01-09-2017 - Pravo dopo quarant'anni cambia sede

01-09-2017 - Pravo dopo quarant'anni cambia sedeRoby C - ago 02 2017 17:08

-

31 luglio 1954... e uno che diverrà un famoso nikonista...

31 luglio 1954... e uno che diverrà un famoso nikonista...Roby C - lug 31 2017 18:48

-

la Vera Storia della Riunione del 29 Luglio...

la Vera Storia della Riunione del 29 Luglio...Roby C - lug 30 2017 22:46

-

Sardegna - Sud Est

Sardegna - Sud Estcris7 - lug 24 2017 19:27

-

Avignone - Il festival off

Avignone - Il festival offMassimo Vignoli - lug 18 2017 21:59

-

[editoriale] Garanzia cinqueminuti...

[editoriale] Garanzia cinqueminuti...Max Aquila - lug 12 2017 12:21

-

[motori] Monza Historic

[motori] Monza HistoricGiannantonio - lug 06 2017 13:39

-

[libro Nikonland centenario] だいすきニコン (daisuki Nikon)

[libro Nikonland centenario] だいすきニコン (daisuki Nikon)Alberto73 - lug 04 2017 21:52

-

[manifestazioni] TRATTA 29 giugno 2017

[manifestazioni] TRATTA 29 giugno 2017tommowok - giu 30 2017 13:23

-

[luoghi] i laghi del Trentino

[luoghi] i laghi del TrentinoAlberto73 - giu 29 2017 21:13

-

[reportage] Tre Torri

[reportage] Tre TorriGiannantonio - giu 28 2017 15:46

-

[Nikonland libro Centenario] come da tag

[Nikonland libro Centenario] come da tagValerio Brùstia - giu 26 2017 00:06

In evidenza

-

Le Nikon del 2017

Le Nikon del 2017Lieve - feb 08 2017 08:36

-

16 ottobre - 2006-2016 : dieci anni della nostr...

16 ottobre - 2006-2016 : dieci anni della nostr...Lieve - ott 16 2016 06:03

-

La Stampa in Bianco e Nero

La Stampa in Bianco e NeroSpinoza - mag 19 2016 19:55

-

Nikon D5 : semper fidelis (test/prova)

Nikon D5 : semper fidelis (test/prova)Lieve - ott 30 2016 17:17

-

La nascita di Nikon (Nippon Kogaku) e la Marina...

La nascita di Nikon (Nippon Kogaku) e la Marina...Lieve - mar 04 2015 11:11

-

Nikon D810 : la terra promessa (test/prova)

Nikon D810 : la terra promessa (test/prova)Lieve - mar 10 2015 13:50

-

Il fascino intramontabile delle foto stampate

Il fascino intramontabile delle foto stampateLieve - mag 22 2014 09:23

-

Calibrare e Profilare il monitor. Guida pratica

Calibrare e Profilare il monitor. Guida praticaSpinoza - mag 13 2014 12:57

Ultime News

-

25 luglio 2017 : fine della ricreazione

25 luglio 2017 : fine della ricreazioneLieve - lug 28 2017 11:02

-

La Nikon D850 ha un mirino ibrido ?

La Nikon D850 ha un mirino ibrido ?Lieve - lug 27 2017 05:40

-

Importante aggiornamento firmware per la Nikon...

Importante aggiornamento firmware per la Nikon...Lieve - lug 12 2017 07:50

-

Nuovo Nikon AF-P 70-300mm F4.5-5.6E VR (FX)

Nuovo Nikon AF-P 70-300mm F4.5-5.6E VR (FX)Lieve - lug 11 2017 07:28

-

New Old Camera : servizio 'demo' e Meet...

New Old Camera : servizio 'demo' e Meet...Lieve - giu 12 2017 07:41

-

Nuovo Nikon 10-20mm F4.5-5.6 VR

Nuovo Nikon 10-20mm F4.5-5.6 VRLieve - lug 07 2017 16:49

-

Nuovo Nikon 8-15mm F3.5-4.5E Fisheye

Nuovo Nikon 8-15mm F3.5-4.5E FisheyeLieve - mag 31 2017 07:23

-

Nuovo Nikon 28mm F1.4E

Nuovo Nikon 28mm F1.4ELieve - mag 31 2017 07:36

-

Fotografia, messaggi, il tempo in cui viviamo.

Fotografia, messaggi, il tempo in cui viviamo.Lieve - giu 25 2017 05:35

-

Il dado è tratto. Sarà il 2018 l'anno mirro...

Il dado è tratto. Sarà il 2018 l'anno mirro...Lieve - lug 12 2017 07:15

Sottoesporre o Sovraesporre ? (RAW, Gamma Lineare e corretta Esposizione)

mar 24 2016 01:00 |

gpb01

in Corso di Fotografia

Questo articolo prende spunto da una presentazione a cui ho assistito tempo fa, in occasione del "Digital Symposium 2006", presentazione tenuta dall'amica Marianna Santoni (Adobe Guru) assieme ad un suo collega.

Contattata ultimamente in merito all'argomento, non solo mi ha fornito il riferimento da cui era partita la sua ricerca, ma mi ha cortesemente anche inviato un estratto degli studi di un tale Bruce Fraser proprio in relazione alla "Gamma Lineare ed Esposizione".

[

Bruce, Scozzese, emigrato a S.Francisco, ha effettuato studi sulla visione umana e sulla sua correlazione con la fotografia. E'autore del libro "Real World Camera Raw" pubblicato da "Peachpit Press" nel Agosto 2004.

Il mio intento qui é quello di esporre il contenuto di questi studi, integrando il tutto con un esempio pratico, da me realizzato, a dimostrazione della "teoria", contestando l'opinione diffusa che in "digitale" sia meglio "sottoesporre" che "sovraesporre" per non bruciare i dettagli nelle alte luci ![]()

Una delle maggiori differenze tra la fotografia "analogica" (su pellicola) e quella "digitale" é sicuramente quella relativa alla "risposta alla luce" di questi due differenti supporti. Difatti, mentre la pellicola ha una risposta che assomiglia a quella dell'occhio umano, il sensore delle digitali ha un comportamento totalmente diverso.

Ignorare questa fondamentale differenza, significa mettersi a rischio di non sfruttare completamente la gamma dinamica del sensore e di avere una maggiore quantità di "rumore" nelle zone delle basse luci.

La risposta alla luce da parte del nostro occhio (e anche da parte della pellicola) é totalmente NON lineare, così come quella di molti dei nostri sensi. Nel nostro cervello é difatti presente un meccanismo di ... "compressione" che ci permette di recepire nitidamente dai segnali più deboli a quelli più alti.

Se prendete in mano una oggetto di un peso X e poi ne aggiungete un secondo, NON avrete la sensazione di un raddoppio di peso; se vi viene fatto ascoltare un segnale acustico e poi l'intensità di questo segnale viene raddoppiata, la sensazione che se ne avrà NON é del doppio; se infine si raddoppia il numero di fotoni che raggiungono il vostro occhio, noterete un aumento della luminosità, ma NON il doppio della luce.

Grazie a questo meccanismo di "compressione" i nostri occhi possono passare dall'osservare qualcosa in una stanza buia dove é presente uan una debolissima luce, all'osservare qualcos'altro in pieno sole, senza rischio di ... "sovraesposizione" anche se la differenza di illuminazione é 10'000 volte superiore !

Al contrario, Il sensore delle nostre fotocamere digitali é puramente lineare ... al raddoppio del numero di fotoni che lo colpiscono, si ha un raddoppio del segnale in uscita.

Prendiamo quindi un'immagine, così come si presenta in uscita dal nostro sensore, lineare e senza alcuna curva di correzione applicata. Quello che avremo sarà un qualcosa che somigli a questo :

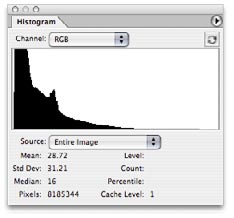

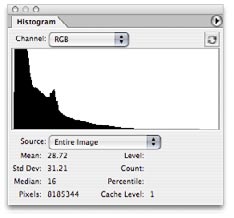

Essa appare evidentemente molto scura, pur contenendo, al suo interno, tutte le informazioni necessarie. L'esame del suo istogramma mostra che la maggior parte dei dati si trova nella parte delle basse luci :

Al fine di adattare questa immagine al nostro occhio, in fase di "sviluppo" del file RAW, a questa immagine viene applicata una curva di correzione "gamma" che ha la seguente struttura :

che porterà ad un immagine così fatta :

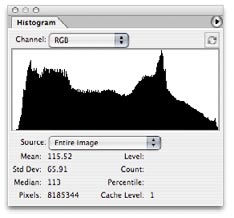

ovvero un'immagine che ci appare molto più corretta e che presenta un istogramma che risulta essere meglio distribuito :

Quindi, il processo che porta da un immagine "lineare", così come ripresa dal sensore, ad una immagine adatta alla nostra vista, é un processo che prende le informazioni contenute nel file RAW e le "amplifica" seguendo una certa curva "gamma".

Scattando in RAW, con una risoluzione di 12 bit, avremo che la nostra immagine é codificata con valori compresi tra 0 e 4095, ovvero 4096 differenti livelli (212 livelli).

Se abbiamo quindi a disposizione 4096 livelli, il livello 2048 indica che il sensore (che ricordo essere lineare) ha ricevuto la metà dei fotoni del livello 4096, il livello 1024 ne rappresenta un quarto e così via.

Ora, attualmente la dinamica dei sensori delle nostre fotocamera oscilla tra i 5 ed i 9 stop. Per il nostro esempio supponiamo di utilizzarne uno con una dinamica di 6 stop.

La distribuzione dell'intensità luminosa su una scala lineare sarà quindi questa :

... il che mostra chiaramente che il numero di livelli (quindi di valori diversi) assegnato alle zone pi? scure e nettamente inferiore al numero di quelli assegnati alle zone più chiare.

Nel nostro esempio (avendo realisticamente supposto una dinamica di 6 stop del sensore) avremo che al primo stop verranno dedicati 2048 livelli, al secondo 1024, al terzo 512, al quarto 256, al quinto 128 ed infine, al sesto, solo 64 livelli.

Applicando successivamente la nostra curva "gamma" noi non facciamo altro che distribuire le informazioni che sono state raccolte in forma lineare secondo una distribuzione "corretta", ovvero più adatta alla risposta dei nostri occhi :

... comprimendo da un lato le informazioni meglio descritte ed espandendo dall'altro quelle peggio descrite !!!

Quale sono dunque le implicazioni pratiche di tutto questo ?

Molto semplice ...

... parecchie persone sono portate a credere che in "digitale" sia meglio sottoesporre per non pelare le alte luci, recuperando poi in camera chiara con il software. Nulla di più sbagliato !

Facendo così essi non sfruttano a pieno i livelli con maggiore quantità di informazioni (le alte luci) andando a comprimere ancora di più le informazioni dove i bit descrittivi sono già pochi (medie e basse luci), ottenendo, in fase di recupero in camera chiara, solo un aumento del rumore proprio nelle ombre ed un notevole riscio di introdurre posterizzazioni nella zona delle basse luci.

In realtà la corretta esposizione in "digitale", scattando in RAW, é quella che ci permetterà di sovraesporre leggermente l'immagine sino al caso limite di avere la sensazione che le alte luci siano un po' pelate (verificabile anche tramite l'istogramma).

Difatti, ricordando che l'immagine che ci viene mostrata sul monitor della nostra fotocamera é il risultato della produzione del .JPG in camera e quindi dell'applicazione di tutte le impostazioni e di tutte le curve di correzione necessarie per adattare l'immagine alla nostra vista, quello che vedremo sul monitor "leggermente pelato", sarà invece perfettamente recuperabile tramite i software di "sviluppo" (Adobe Lightroom, Bibble Pro, Capture NX, ecc. ecc.).

Passiamo ora ad esaminare in pratica quanto qui sopra esposto in teoria.

La prova si é così svolta :

scelto un soggetto ho effettuato TRE scatti : uno leggermente sottoesposto (-2/3 EV), uno correttamente esposto ed uno leggermente sovraesposto (+2/3 EV).

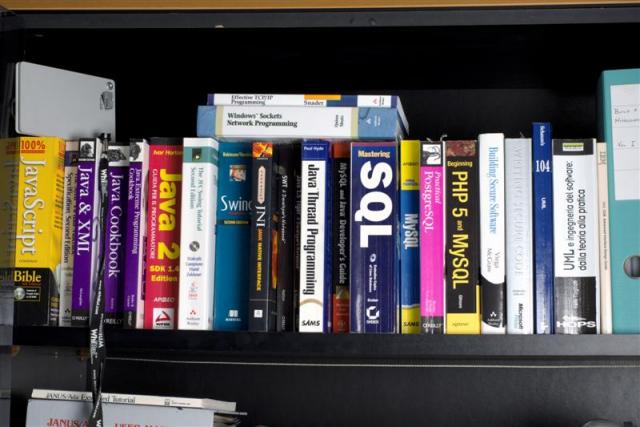

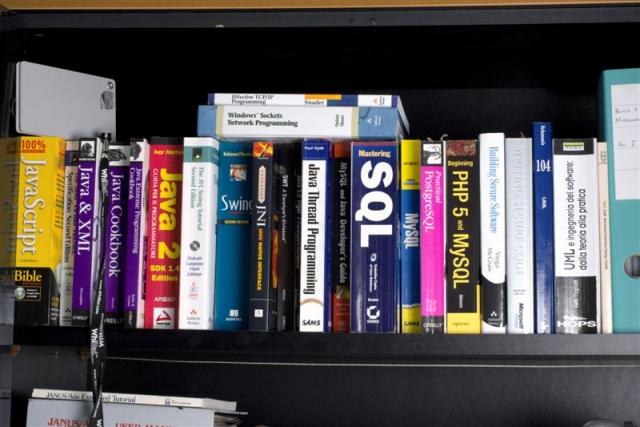

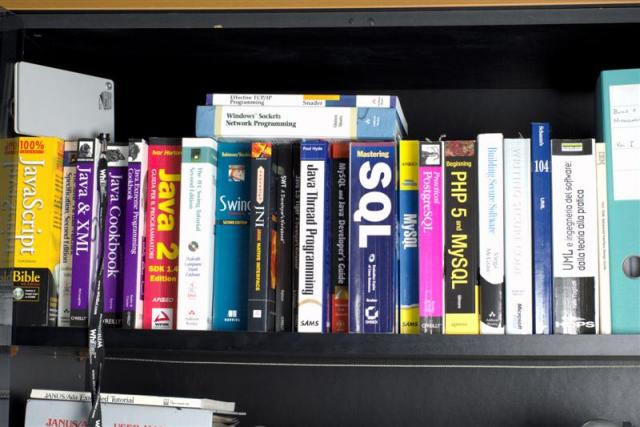

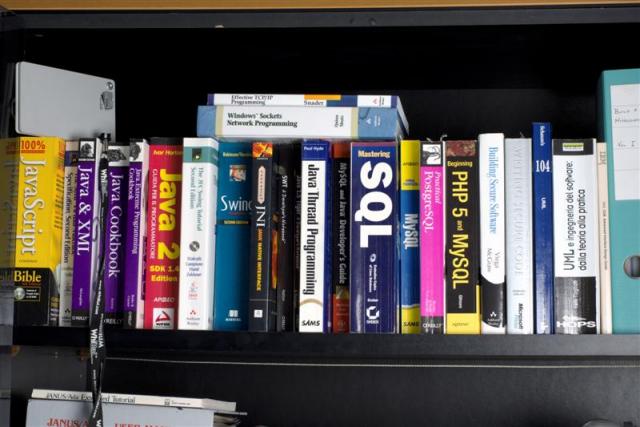

Gli scatti sono stati fatti con la Nikon D2x e con il Nikkor 50mm f/1.4 D montati su cavalletto e l'illuminazione é stata fornita da un flash da studio Elinchrom BX400 con montato di fronte un bank bianco 60x60.

Ovviamente l'esposizione é stata regolata manualmente. Quella corretta era 1/125" F8; la sottesposta é stata fatta a 1/125" F10 e la sovraesposta a 1/125 " F6.3

Le immagini sono state poi "sviluppate" dal RAW in .JPG con Bibble Pro 4.9.5 azzerando qualsiasi correzione (ho usato Bibble Pro perché consente un accurato controllo di tutti i paramentri di esposizione). Ed ecco qui i tre scatti originali (essendo notevolmente ridotti spero si apprezzi comunque ad occhio la sotto e sovra esposizione) :

1/125" F6.3

1/125" F8

1/125" F10

In seguito, sempre tramite Bibble Pro 4.9.5, ho corretto l'esposizione delle due foto (la sovraesposta e la sottoesposta) portando quindi le tre immagini allo stesso livello di luminosità :

1/125" F6.3 .. corretto con -2/3 EV

1/125" F8

1/125" F10 .. corretto con +2/3 EV

Il primo é relativo al nodino del laccetto della WhiBal che é poggiata sopra ai libri. Tale nodino crea anche delle leggere ombre che ci sono utili per l'esame :

Particolare della sovraesposta corretta -2/3 EV

Particolare della esposta correttamente

Particolare della sottoesposta corretta +2/3 EV

E' ben visibile nella prima immagine una minore quantità di rumore ed una maggiore pulizia complessiva, frutto proprio della leggera sovraesposizione che ha permesso di sfruttare meglio i pochi livelli dedicati alle basse e medie luci.

La seconda immagine é l'immagine correttamente esposta in cui, seppur in minima parte, si nota un maggior rumore e la terza e la sottoesposta che da sicuramente il risultato peggiore !

Il secondo crop al 100% ? relativo ad un altro punto critico ... il nero di fondo. Il particolare é relativo all'angoletto di color viola alla base del libro "Effective TCP/IP Programming" messo in orizzontale sopra agli altri

Vediamo le immagini :

Particolare della sovraesposta corretta -2/3 EV

Particolare della esposta correttamente

Particolare della sottoesposta corretta +2/3 EV

Anche qui, visualizzando a pieno ingrandimento l'immagine, risulta evidente la minore quantità di rumore sul nero che si ha nell'immagine sovraesposta (e poi corretta) se paragonata con le altre due.

Bene, da quanto detto e da quanto dimostrato praticamente, spero sia chiaro ora a tutti che la vecchia usanza di "sottoesporre" leggermente le foto, in "digitale" é più dannosa che altro.

Lavorando in RAW e applicando una leggera sovraesposizione si otterrano delle immagini finali "sviluppate" di qualità nettamente maggiore con minore rumore e maggior pulizia proprio nelle basse e medie luci.

Fatene tesoro ...

Colgo infine l'occasione per ringraziare ancora Marianna Santoni per il materiale fornitomi, che mi ha permesso di illustrare l'aspetto teorico.

©2008 - 2010 Guglielmo Braguglia per Nikonland - riproduzione riservata

0 user(s) are online (in the past 15 minutes)

0 utenti, 0 ospiti, 0 utenti anonimi

139 Comments

Qualunque cosa voglia dire (quindi qualsiasi ragionamento ci sia alla base).

Salvaguardando le altissime luci, ovviamente.

Alessandro, posso dire che ti fai un po' prendere dai numeri?

Cosa ti interessa l'estrema precisione?

Una foto ? sempre la rappresentazione di quello che hai in mente, poco importa se poi su Capture devi impostare -1EV e magari su Lightroom -1.3EV opure -0.6EV.

Il risultato finale ? quello che conta, anche perch? in ogni caso pure l'esposizioe pu? avere bisogno di una compensazione a seconda (ad esempio) della carta su cui stampi oppure della stampante stessa.

Quello che conta ? il risultato finale, e pu? capitare (e capita....

E probabilmente l'esatta quatit? di compensazione non ? neppure cos? costante a seconda del soggetto.

In linea di massima la correzione ? intorno all'unit?, ma ovviamente cambia a seconda del programma di sviluppo (e della sua versione).

a_

Effettivamente io mi faccio trascinare troppo dai numeri, forse una cosa gradevole ? meglio di una cosa precisa

L'effetto non ? mai esattamente quello che otterresti con una "vera" sottoesposizione (? anche per questo che stigmatizzavo l'eccessiva attenzione per i numeri

Chiunque abbia usato la versione 1.X di LightRoom, si ricorder? certamente la tendenza (mitigata nella 2) ad aprire spesso eccessivamente le ombre in fotografie a volte globalmente sottoesposte e poco luminose.

? la prova che nel processo di sviluppo ogni zona di luminosit? differente viene trattata separatamente.

In questo modo la sovra e sottoesposizione non rispondono perfettamente alle logiche ferree che dovrebbero esistere in teoria.

A questo aggiungiamo che il gamma (quindi la "compressione delle ombre") non ? esattamente quello dell'occhio umano e nemmeno quello della carta di stampa (quale carta?)....

Per cui a seconda della foto potrebbe essere necessario compensare di valori diversi da quello della sovraesposizione intenzionale iniziale.

Chiaramente non mi aspetto di dover correggere per tre EV una foto sovraesposta di 2/3.

Ma di un numero pi? o meno compreso tra 2/3 ed 1.4 si.

a_

da stampare

a_

Corretto TM?

Ciao

Fabrizio

... ricordo altres? che, pur essendo le discussioni pubblicate su di un forum, sono e restano propriet? intellettuale di chi le a scritte e che quindi, per un loro uso o pubblicazione in altri luoghi, ? sempre necessaria l'autorizzazione dell'autore.

Guglielmo

dato che fino ad oggi la mia risposta era non uso raw...

Parto dalla linearit? del sensore: se x ? il segnale in ingresso cui corrisponde y come uscita, a 2x corrisponde 2y.

Visto che gli stop sono separati proprio da un fattore 2, mi verrebbe da dire che il sensore vede tanti stop quanti sono i sui bit.

Quindi mi viene da pensare che la D70s abbia una latitudine di posa di 12 bit.

All'atto pratico sono 5. Che fine fanno gli altri 7?

Io pensavo ad un rapporto segnale rumore troppo basso. Se questo fosse vero, vengono scartati via software? Come si passa da 12 a 5?

C'? un errore grossolano nella tua dissertazione matematica.

L'esponente.... o Gamma.

a_

Onestamente non riesco a capire l'errore nel dire che se il sensore a 12 bit vede 12 stop. Uno stop ? il doppio del successivo e ogni bit ? separato dal successivo di un fattore 2. Dov'? l'errore? Sono certo che sto sbagliando qualcosa, ma non riesco a capire cos'?.

L'articolo dice che i sensori hanno una dinamica di 6 stop, ma non mi torna proprio, dal punto di vista teorico. In pratica lo so, ma la teoria non riesce ad appoggiare questo dato.

HELP! ce sto a impazz? e sono sicuro che gli sto vicino, ci deve essere una virgola fuori posto

Per? mi sono state riferite argomentazioni agli antipodi.

Ad esempio ho sentito che su D70 l'esposizione a destra non funziona perch? la D70 fornisce RAW compresssi e pi? precisamente i 4096 valori di cui sopra sono ridotti a 683, da 0 a 215 non c'? compressione da 216 a 4095 inizia la compressione ed aumenta sempre di pi? fino allo stop pi? luminoso. questo significa che lo stop pi? luminoso non conterr? pi? 2048 valori possibili, ma soltanto 161 e mi hanno mandato anche due link:

http://home.comcast....es/image002.gif

http://home.comcast....ression_683.txt

Inoltre, sempre la stessa fonte, riporta che un tizio ex IBM ha realizzato un semplice test atto a confutare quanto asserito da Reichmann sull'esposizione a destra. Ha realizzato via software una scala di grigi con 11 valori, da 0 a 10, 0 per il nero e 255 per il bianco ipotizzando una profondit? di gradazioni di 8 bit:

http://www.rags-int-...ff/TonesnZones/

ogni valore su questa progressione spostandosi da sx verso dx rappresenta un dimezzamento della luminosit? e il numero 5 corrisponde al grigio al 50%. poi ha fotografato con la sua Nikon D1X il cartoncino del grigio che riflette il 18% della luce (e che corrisponde al grigio al 50%) 11 volte con incrementi di uno stop. in questo modo ha ottenuto una seconda scala di valori di grigio ed ? andato a rilevare il corrispondente valore a 8 bit dai file nella memory card della fotocamera. con questi valori ha realizzato un grafico (quello giallo) che presenta una retta rossa e una curva blu, sull'ascissa ? rappresentato il livello di grigio e sull'ordinata i bit da 0 a 255. la linea blu ? fatta con i dati rilevati sperimentalmente con la nikon mentre la retta rossa rappresenta la condizione ideale (la scala creata via software). questo grafico dimostrerebbe una cosa molto importante, che le motivazioni addotte da Reichmann sono 'baggianate'. se il texano non ha fatto il gioco delle tre carte e se questo semplice test risulta essere ripetibile su ogni fotocamera che produce RAW non compressi lossy, Reichmann si ? inventato una motivazione fasulla per la sua tecnica di esposizione.

Non ti nascondo che la chiacchierata, per cos? dire, ? stata ed ? piuttosto animata, ma a questo punto il dubbio mi ? venuto.

Avendo studiato ingegneria elettronica, tutti i passi che portano alle motivazioni dell'esposizione a destra mi sono tutti ben chiari e come ti dicevo li ho messi sempre in pratica; ma mi aiuti a trovare una spiegazione a queste argomentazioni che vano in linea opposta?

Cio? alla fine della fiera... chi ha ragione?

C'è però da considerare che questa compressione viene fatta DOPO aver acquisito l'immagine a 12 bit, in fase di salvataggio sulla memoria. Durante la fase di scatto e acquisizione in realtà non c'è nessuna compressione, quindi, migliorare i dati posti nella zona delle basse luci avrà comunque l'effetto descritto. La successiva compressione non farà altro che eliminare dei valori nelle alte luci.

Ho letto il test e salta subito agli occhi che i risultati sono falsati per come lui ha predisposto la scala dei grigi !

Non ha difatti preso una scala lineare, ma si è costruito LA SUA SCALA secondo il sistema zonale di Ansel Adams, ponendo LUI il grigio 50% al centro di detta scala, ovvero ... ha già effettuato una correzione gamma in partenza

In realtà, se prendi una scala puramente lineare, ti accorgerai che il grigio 50% NON è affatto al centro !!! Insomma ... ha barato con i dati di partenza

Chi ha ragione ? NOI naturalmente

Guglielmo

Guarda lì l'errore che fa Rags Gardner.....

Se riflette il 18% della luce, perchè il grigio miracolosamente è al 50%?

A parte il fatto che il "tizio ex IBM" è Rags Gardner, lo stesso che ha inventato lo script per calibrare la fotocamera (quello di cui ho parlato QUI)...

Nel suo articolo (l'unico che ho letto dei tuoi link perchè già lo conoscevo) ha comunque preso un abbaglio.

O meglio, ha confrontato due andamenti (le "zone alla Adams" e gli effetti dell'esposizione sui files RAW) che sono già corretti per il Gamma.

...Lo stesso errore che hai fatto tu una o due pagine indietro...

Sarà un caso che sei andato a cercare, tra tutte le trattazioni corrette che ci sono sul web (a cominciare da quello che Guglielmo ha scritto qui su Nikonland in questo tutorial) quella che ha lo stesso tuo errore di fondo?

a_

Resta da vedere se con i nuovi sensori a 14bit la compressione ? identica o no.

Non mi pare esista ancora nulla a riguardo.

a_

Le fotocamere coinvolte sono : D70/D70s, D40/D40x, D50, D60, D80, D90.

Tutte queste, meno la D90, utilizzano una "tabella di codifica" a 683 elementi e cominciano a comprimere dal valore 216.

La D90 utilizza una "tabella di codifica" a 769 elementi e comincia a coprimere dal valore 114.

Le altre fotocamere hanno tutte la possibilità di scegliere tra comprimere e non comprimere e, le ultime (D300, D3, D3x), offrono anche una compressione "loss less" (stile .zip).

D2H/D2Hs, D2X/D2Xs, D200, in modalità NEF compresso, utilizzano una "tabella di codifica" a 683 elementi e cominciano a comprimere dal valore 216.

D300/D3/D3x, in modalità NEF 12 bit compresso "lossy", utilizzano una "tabella di codifica" a 689 elementi e cominciano a comprimere dal valore 240.

D300/D3/D3x, in modalità NEF 14 bit compresso "lossy", utilizzano una "tabella di codifica" a 2753 elementi e cominciano a comprimere dal valore 640.

Guglielmo

Altra cosa. Io ero abbastanza pronto a rispondere sulla questione del grigio 50%, mi serviva la conferma ufficiale. Insomma, ha fatto la stessa cosa che feci io, solo che ho avuto l'accortezza di non farci il figo in giro

La questione della compressione dopo lo scatto non la sapevo. Ottima a sapersi!

Al solito fantastici!!

Scherzi a parte, è un problema quando uno come Gardner scrive delle cose così, proprio perchè non è "uno qualunque" e giustamente di solito gli si da il peso che merita il personaggio.

Il problema è che il suo sito è datatissimo, non updatato da più di due anni (ed a voler guardare... anche nel 2007 un sito fatto in quel modo non è certo una garanzia di aggiornamento...).

Probabilmente o nel frattempo ha cambiato mestiere, o semplicemente sono due anni che è convinto di non avere più una homepage.

Ringrazio anch'io Guglielmo per i numeri dei nuovi sensori.

Nuovi sensori che tra l'altro hanno due tipi di compressione: uno con perdita di qualità (che è quello, aggiornato ai 14bit per canale, delle varie D70/D40/D80 etc).

Ed un altro "lossless".

Quest'ultimo dovrebbe essere senza perdita di qualità.

Io non ne so nulla, e mi fido, per cui dovrebbe essere una cosa "tipo ZIP o LWZ" (non me ne vogliano gli informatici che leggono) che effettivamente dovrebbe solo risparmiare spazio.

a_

P.S. Detto tra noi, con la D700 mi capita spesso di usare anche la compressione con perdita di qualità (ma sempre a 14bit).

Nelle foto a colori, e ci ho fatto tutte le foto a colori delle vacanze, se prima era difficile che la compressione andasse ad intaccare in modo visibile la qualità, ora non ho ancora visto neppure un problema.

Insomma, ce ne per tutti i gusti

Guglielmo

Onestamente penso di non sbagliare perch? se ? vero che a 14bit con perdita si hanno 2753 livelli sono sempre meno dei 4000 e rotti che permette un RAW 12bit compresso lossless... isn't it?!?!?

Ciao, Ale.

Pare essere così.

Quindi... le ombre sono sempre salvaguardate (dove ho meno dati per descriverle, according to Guglielmo's topic).

Ma se io ho 14bit, sia senza compressione che con compressione lossless ho una migliore descrizione delle ombre rispetto ai 12bit per canale.

È vero che il totale dei livelli per canale è più basso, ma dovrebbe essere altrettanto vero che le ombre (zone più critiche per una miriade di motivi) sono meglio descritte comunque, con 14bit.

Quindi... se la compressione lossless non tocca le ombre, è meglio avere 14bit compressi piuttosto che 12bit non compressi.

Comunque, per dirla tutta, io uso sempre i 14bit.

Normalmente con compressione lossless e basta.

Se ho bisogno di spazio (uccelli, vacanze) metto la compressione con perdita alle foto a colori.

Mai a quelle in BW.

Se ho una macchina con 14bit per canale, perchè devo usarne solo 12?

a_

La logica che prevede una serie di "scalini" maggiore nelle ombre con i 14 bit la capisco benissimo, tuttavia non riesco a vederne l'utilit? in modo inderogabile...preferisco a questo punto sfruttare la "ridondanza" dei dati che a me serve molto di pi? nelle alte luci perch?, esponendo a destra e poi riadattando l'esposizione, pur con 12bit ma "pieni" penso di avere "statisticamente" migliori possibilit? di recupero sulle alte luci (che sono quelle che mi interessano, le basse luci della D700 non mi hanno mai dato nessun pensiero n? a 12 n? a 14 bit, compresse o meno...).

Tuttavia io questa storia dei 12 e 14 bit onestamente non la trovo molto indicativa di qualit?, nel senso che anche scattando a 14 bit senza nessuna compressione non noto migliorie di sorta sulle foto se confrontate con i 12 bit alla stessa qualit?. Non so... in cuor mio evidentemente mi sono convinto che si tratti perlopi? di una trovata vagamente commerciale... forse sbaglio

Ciao, Ale.

I ragionamenti si fanno, giustamente, sulle proprie esigenze ed abitudini.

Io sono uno di quelli che crede in una maggiore divisione del segnale per avere il massimo di dati.

Anche se poi non si usano praticamente mai.

Se non ho mai sentito l'esigenza di pi? bit sulla D2x, ora mi trovo francamente in imbarazzo.

La dinamica del sensore della D700 ? altissima, al punto che mi trovo spesso a doverla ridurre per "fare entrare tutto nella stampa".

Ma, soprattutto, mi trovo spesso a "osare" i limiti del sensore, pretendendo di ritrovare in LR delle sfumature che solo stampando in casa un BW si possono pretendere.

E di solito mi riesce.

? in questi casi che, pur senza avere fatto delle prove specifiche, mi pare proprio il caso di usare tutti i bit di cui dispongo.

Perch? spesso questi "recuperi" sono in foto BW, spesso (molto spesso) con ISO assurdi....

Per cui ho preso questa abitudine, fin dall'inizio.

Non so in che condizioni ti trovi pi? spesso tu, ma io almeno un quinto delle foto le faccio a 3200ISO, e per recuperare i particolar che si recupera in quelle condizioni non penso che i 14bit siano un'operazione commerciale.

Anche la mia ? un'analisi dettata dall'esperienza e dalle mie idee, non da calcoli precisi o prove al limite, per cui opinabile fin che si vuole.

a_

P.S. Non so se era gi? stato segnalato, ma IN QUESTO BLOG c'? un'interessante comparazione tra NEF compressi e non (da D200).

Vale la pena di essere letto.

Dal canto mio un pò di tempo fa avevo fatto questo "esperimento"..... te lo riporto così com'è:

/---------------------/

ho fatto gli scatti al cartoncino grigio anche se ho fatto solo di stop in stop, non avevo voglia di fare tre scatti ogni stop

Comunque... questi sono i risultati: sono uguali, almeno per quanto riguarda il file in zeroed e con nessuna lavorazione. Questi i crop al 100% messi in scala, a sinistra i 12bit e a destra i 14bit...

http://private.train.../1214bit/12.jpg http://private.train.../1214bit/14.jpg

Questa invece una prova sui recuperi. Oltre a quelli postati sopra che vanno da dove si vede un minimo di dettaglio nelle basse luci a quelli dove c'è un minimo di dettaglio nelle alte luci ho scattato altri tre fotogrammi nelle alte luci(forse avrei potuto spingermi anche nelle basse, ma oramai...). Ho poi recuperato di -4EV gli ultimi 4 fotogrammi della sequenza, quindi vedrete l'ultimo postato nella scala e gli altri tre che non avevo postato.

Questi i risultati 12bit sopra e 14bit sotto:

http://private.train...1214bit/12_.jpg

http://private.train...1214bit/14_.jpg

Anche qui non mi pare di notare un granchè di differenze...

/---------------------/

PS: non posso inserire i TAG IMG perchè il sistema mi nasconde le immagini, mi dice che non sono autorizzato "on this board"

Ciao, Alessandro.

[scusa Ale, ma perché le immagini non le inserisci semplicemente come allegati ? Almeno il sistema le ridimensiona e crea i thumbnail. Nel caso del tag "img" invece le immagini vengono inserite così come sono con il rischio di avere delle immagini giganti all'interno del post ! - gpb01]